- Ya se observan videos, fotos y audios creados con inteligencia artificial impulsados por empresas de consultoría, y se espera que aumenten durante las elecciones en América Latina y EEUU, señalan expertos.

Voz de América

Syndy Garcia

(Foto superior): Las imágenes creadas por Eliot Higgins con el uso de inteligencia artificial muestran una pelea ficticia entre Donald Trump y agentes de policía de la ciudad de Nueva York. [Foto: Archivo/AP]

En la web aumentan los audios, videos e imágenes falsas creadas con inteligencia artificial (IA) generativa, conocidos como deepfakes, a medida que se acercan las elecciones en varios países de Latinoamérica y en Estados Unidos este año, aseguran expertos.

Estudios de opinión y especialistas en el análisis de la desinformación coinciden en que la inteligencia artificial da un impulso a la creación de contenido falso en distintos formatos, y especialmente durante elecciones.

A nivel mundial, el 74 % considera que la IA está facilitando la generación de noticias e imágenes falsas muy realistas, según la encuesta Global Advisor de IPSOS, una empresa de investigación de mercados que consideró el análisis en 29 países con más de 21.000 adultos.

Para este 2024 que se estima que más de 50 países acudan a las urnas.

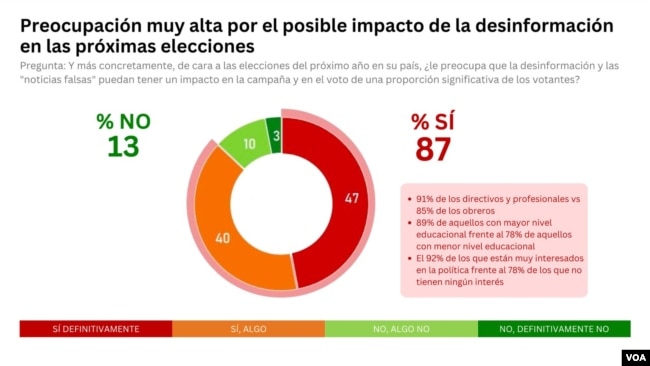

na encuesta realizada por IPSOS para la UNESCO con 8.000 personas de 16 países destaca que al 87 % le preocupa que la desinformación y las “noticias falsas” puedan tener un impacto en la campaña y en el voto de una proporción importante durante el proceso electoral de su país, en un momento donde las redes sociales se han convertido en principal fuente de información.

Desinformación con IA en las elecciones en Latinoamérica y EEUU

Especialistas que han analizado la desinformación realizada con inteligencia artificial aseguran que la misma ha permeado aún más conforme se acercan las elecciones.

¿Cómo funciona?

Carlos Piña García, doctor en Ciencias de la Computación por la Universidad de Essex y quien tiene investigaciones sobre el contenido generado por los usuarios en plataformas como X (antes Twitter) y Facebook dijo a la Voz de América que la desinformación se genera regularmente a través de empresas consultoras o de marketing y depende de los recursos con los que cuente cada campaña.

A través de estas empresas de consultoría se logran vender “servicios de posicionamiento mediático”, el cual puede incluir “campañas negras, filtración de información, sembrado de desinformación”, así como “campañas de ataques a opositores”, explicó.

En el caso de este año electoral, lo que se espera en Latinoamérica y Estados Unidos es el uso de la inteligencia artificial en deepfakes para atacar a opositores, agregó.

“Nos va a sorprender cómo ganar la narrativa en estas plataformas digitales es dañar, no es ganar elecciones, sino que (la desinformación en) las redes sociales funciona como un mecanismo para dañar la democracia, un mecanismo para atacar opositores”, explicó, y agregó que lo que se busca es ir por aquellos que tiene duda de por quién votar.

Piña dijo que “hay muchas personas que van a caer en este tipo de juego. ‘Yo vi en las redes sociales’, ‘me compartieron a través de un vídeo’, ‘yo vi en TikTok qué pasó esto’, y por lo tanto voy a votar por este”, dijo.

«Es ahí donde funcionan muy bien estas plataformas digitales, en hacer que las personas que estén en medio o que estén dudosas por quién votar terminen votando por el candidato más mediático o que más engagement tenga en la plataforma de su preferencia», ya sea TikTok, Twitter Facebook o Instagram.

De acuerdo con la encuesta de IPSOS, el 56 % de los usuarios de internet utilizan con frecuencia las redes sociales para mantenerse informados sobre la actualidad, y el 68 % dijo que en las redes sociales es donde la desinformación está más extendida.

Alberto Escorcia, periodista investigador y experto en el análisis de la desinformación en línea, dijo que en el caso concreto de la IA se espera ver “portadas falsas de medios, la alteración de sondeos y en los audios falsos para confundir al electorado”.

Cuenta que a la fecha ha detectado cientos de anuncios en Facebook generados por inteligencia artificial con una misma estructura.

“La tecnología es más avanzada pero la forma de hacerlo es muy similar. Es decir, comparte la estructura. Es muy fácil detectar estos discursos hechos con inteligencia artificial que comienzan con un titular muy escandaloso, muy sentimental, luego una breve introducción y al final muchos íconos”, explicó.

Heather Ashby, directora asociada del programa del Instituto de Paz de los Estados Unidos (USIP por sus siglas en inglés) sobre Tecnologías Disruptivas e Inteligencia Artificial, escribió en un artículo especializado que la IA ha reducido los costos para crear y difundir deepfakes.

“Cualquier persona con algunos conocimientos de codificación y acceso a diferentes aplicaciones de software disponibles para descargar en teléfonos móviles o mediante un navegador web puede crear un deepfake con poco esfuerzo”, dijo en el análisis.

Los deepfakes “van desde vídeos que tergiversan la salud mental de un político hasta la creación de imágenes pornográficas de mujeres, en particular periodistas y funcionarios de la esfera pública”, dijo.

“Este tipo de abuso en línea combinado con otras formas de acoso digital probablemente será prominente contra las mujeres que se postulan para cargos públicos en 2024 o informan sobre las elecciones, y requiere una mayor atención para evitar que las mujeres reduzcan su participación en la esfera pública, lo que sería increíblemente perjudicial para la democracia”, apuntó.

Sin embargo, reconoce que la desinformación no necesita de la IA para que circule, sino que esta se instala antes, durante y después del proceso electoral.

Deepfakes en EEUU, México y El Salvador

Previo a las elecciones de Estados Unidos, México, El Salvador y Panamá, entre otros países, ya han circulado desinformaciones realizadas con inteligencia artificial, algunas relacionadas con los procesos democráticos y otras para estafar o recrear a aspirantes a la presidencia.

El caso más representativo fue el del pasado 22 de enero, con un deepfake del presidente de EEUU donde se escucha la voz falsa de Joe Biden pidiendo a los votantes de Nuevo Hampshire no ejercer el voto en las primarias demócratas.

“Su voto hace la diferencia en noviembre, no este martes”, es parte de lo que se escucha en el audio que parece la voz de Biden. El departamento de Justicia de Nuevo Hampshire explica que se trata de una llamada que parece ser generada artificialmente y que existe una investigación en curso.

En México, la precandidata a la presidencia Claudia Sheimbuam, afín al partido del presidente mexicano, Andrés Manuel López Obrador, también ha sido víctima de varios deepfake para intentar estafar en el que se asegura que se pueden hacer inversiones con una empresa de petróleo.

Sheimbuam desmintió uno en su cuenta de Facebook y otro fue verificado por Reuters. En uno de los videos fue modificada con IA una entrevista del medio DW que asegura que invirtiendo 4.000 pesos se garantiza una ganancia de 43.000 pesos mensuales, lo cual es falso.

En TikTok han circulado varias imágenes realizadas con inteligencia artificial con fines de entretenimiento relacionadas con el presidente de El Salvador con licencia Nayib Bukele.

El impacto de las plataformas en la desinformación en medio de elecciones

Un informe de Free Press, una organización no partidista que lucha por los derechos a conectarse y comunicarse, hizo un análisis sobre los retrocesos de las empresas tecnológicas.

El análisis señala que entre el 1 de noviembre de 2022 al 1 de noviembre de 2023, Meta, Twitter (ahora X) y YouTube eliminaron un total de 17 políticas críticas en sus plataformas, entre estas:

- Twitter y YouTube dieron marcha atrás a las políticas de desinformación electoral diseñadas para limitar el contenido de “la gran mentira” sobre las elecciones de 2020 en EEUU.

- Twitter y Meta revocaron políticas que habían prohibido desinformación sobre COVID-19.

- Twitter (ahora X) comenzó a permitir anuncios políticos en la plataforma y dejó de aplicar una política de publicidad que exigía transparencia y etiquetado en dichos anuncios.

Free Press evidenció que hubo despidos en Meta, X y YouTube en donde se produjeron recortes en las categorías de moderación de contenido/consultor, aquellos que tendrían la tarea de mantener la salud general de las plataformas.

IPSOS en su encuesta reveló que el 89 % de los usuarios en internet está de acuerdo con la idea de que “los gobiernos y reguladores puedan exigir a las plataformas medidas de confianza y seguridad durante las campañas electorales para proteger la integridad de las elecciones”.

En el análisis de IPSOS también se muestra que los propios ciudadanos podrían tomar medidas para abordar el fenómeno de la desinformación en línea. Al momento, sólo el 48 % de las personas dijo que ha denunciado contenidos en línea relacionados con el contexto de una campaña electoral.

¿Cómo lograr desarticular la desinformación que circula? De acuerdo con Escorcia, experto en el análisis del contenido falso en línea, las personas y usuarios en general podrían utilizar herramientas digitales o el propio Chat GPT para contrarrestar deepfakes o contenidos ficticios creados con IA.

“Para la gente que quiera detectar si esto es falsos o verdadero también hay otras características: que los vídeos falsos no suelen durar más de un minuto, son muy escandalosos y que narran hechos que no corresponden con la realidad. Entonces cualquier cosa que les parezca escandaloso, pero que tenga una misma estructura que se parezca mucho a lo que han visto antes y que sea de dudosa credibilidad, creo que es un elemento para que la gente pueda entender que se trata de Inteligencia Artificial”, dijo.

La organización de verificación de Maldita.es cuenta también con una caja de herramientas digitales que permite a las personas saber si las publicaciones que revisan contienen desinformación.