Todos queremos saber más sobre la Inteligencia Artificial (IA). Como sucedió primero con internet y luego con las redes sociales, su llegada creó expectativas, temores y abrió oportunidades, pero también provocó temores. Se pueden aprovechar para el bien, pero también para el mal. Esta entrevista con un reconocido periodista y escritor ilustra el tema».

Gonzalo Marroquín Godoy

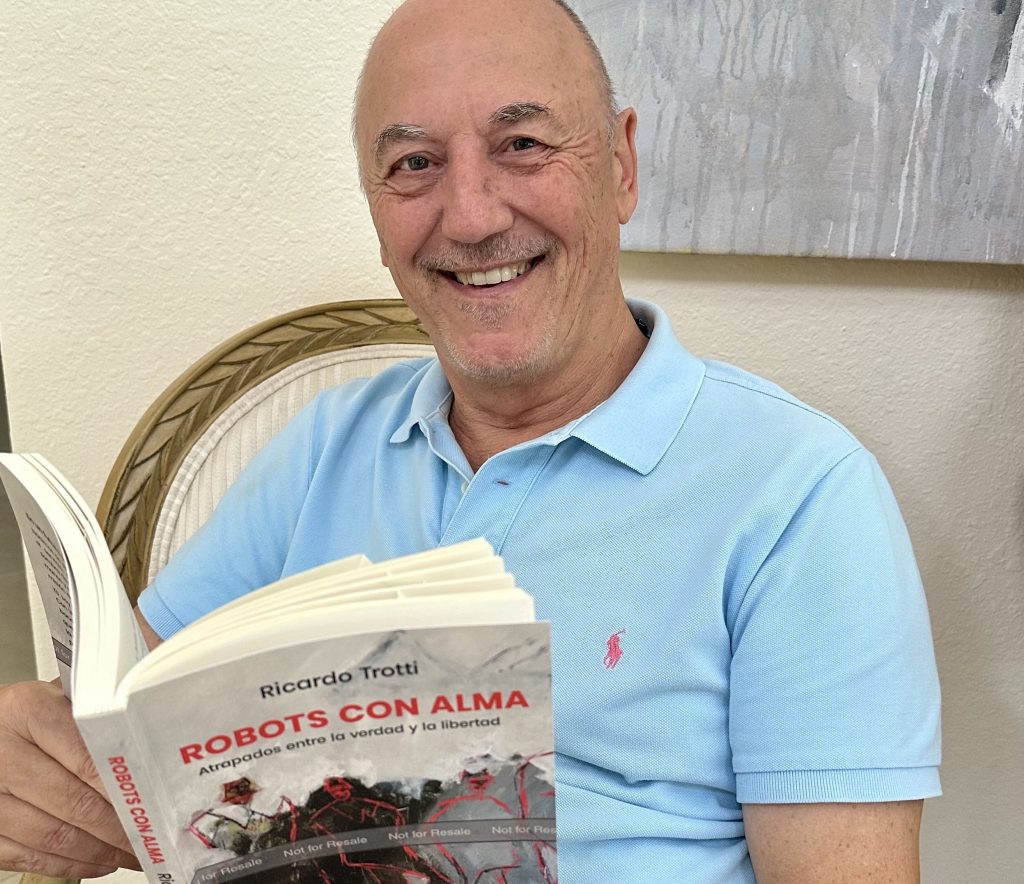

Ricardo Trotti es un periodista argentino con una amplia trayectoria en la defensa de la libertad de expresión en el continente. Durante más de una década fue director ejecutivo de la Sociedad Interamericana de Prensa (SIP), desde donde impulsó debates sobre prensa, democracia, autorregulación y ética periodística en América Latina, en contextos marcados por la presión política, la censura y la transformación digital de los medios.

En los últimos años, Trotti ha alcanzado nueva proyección internacional como autor del libro Robots con Alma: atrapados entre la verdad y la libertad, y el ensayo Dotar de alma a la Inteligencia Artificial, obras en las que reflexiona sobre los dilemas éticos, humanos y sociales que plantea el avance acelerado de la IA. A partir del libro se ha convertido en un referente del debate sobre inteligencia artificial en el mundo hispano. Ricardo respondió a la entrevista de Crónica sobre el tema y esto nos respondió:

Usted dice que la Inteligencia Artificial cambiará nuestra forma de vivir y trabajar. ¿Cuál cree que será el cambio más profundo que experimentará la sociedad en los próximos cinco años?: Creo que el cambio más radical no será ver robots caminando por la calle, sino que la IA se volverá invisible e indispensable, como la electricidad. En los próximos cinco años dejará de ser una herramienta externa y se disolverá en el ambiente. Estará integrada en cada procesador de texto, en diagnósticos médicos, en sistemas financieros y decisiones cotidianas, ámbitos donde ya opera en silencio. Pasaremos de usar la tecnología a vivir dentro de ella. Será un socio intelectual permanente.

La historia ofrece un espejo. Con el Internet sucedió igual. Le tuvimos miedo, desconfianza y luego fue una integración total. La tecnología avanza por ensayo y error. Con la IA viviremos una etapa similar y habrá ajustes. Un ejemplo son los periódicos, regalaron contenido creyendo que era el camino y luego vieron el daño.

Lo que cambiará es la frontera de la creatividad. Cualquiera podrá generar música, imágenes o películas desde su habitación. Pero, paradójicamente, esa facilidad hará más valiosa la chispa humana.

En su ensayo “Dotar de alma a la IA” aborda tanto el potencial como los riesgos de la IA. ¿Cuáles considera que son los peligros que encierra la IA?: La tecnología es un espejo amplificador. Si está sucio, deforma. El riesgo inmediato es la erosión de la verdad. Las IAs son probabilísticas; pueden inventar hechos con total elocuencia.

Otro peligro es el sesgo inadvertido. Como la IA aprende del pasado y la historia está llena de racismo, machismo y desigualdades, la tecnología tiende a perpetuar esos defectos. Por eso insisto en dotarla de “alma”, de una ética incorporada desde el diseño. Hablo de principios programables. Expertos como Stuart Russell han demostrado que es posible priorizar la seguridad humana sobre la eficiencia. Ya existen modelos de “IA constitucional” que obedecen reglas éticas antes de responder.

Incluso con esa ética, es peligroso delegar en algoritmos sin transparencia decisiones críticas sobre nuestras vidas, como quién recibe un crédito o quién recibirá un órgano donado.

Muchos temen que la IA reemplace trabajos humanos. Desde su investigación, ¿qué trabajos desaparecerán primero y qué nuevos empleos surgirán?: Soy optimista basándome en la historia. Mis hijos trabajan hoy en Marketing Digital, una profesión que no existía cuando yo tenía su edad. Si en los noventa hubiéramos prohibido Internet para proteger a los tipógrafos, esa generación no habría tenido las oportunidades que hoy tiene.

Así como ocurrió con los tipógrafos, desaparecerán disciplinas y tareas, y otras evolucionarán. Lo que se irá primero es lo repetitivo y tedioso, como la traducción básica, los informes rutinarios o el análisis mecánico de datos. Cuando apareció la calculadora Texas Instruments no reemplazó a las matemáticas, ni al álgebra, ni al pensamiento lógico; simplemente eliminó el cálculo manual lento. La IA hará lo mismo con nuestra burocracia mental.

A cambio surgirán nuevos oficios como curadores de datos, auditores de sesgos, supervisores de IA en instituciones públicas. Y esto nos permitirá revalorizar lo humano. La IA nos quitará la parte robótica del trabajo para permitirnos ser más humanos.

¿Cómo pueden reproducirse o amplificarse las desigualdades sociales mediante sistemas de IA, aun cuando sus programadores no lo pretendan?: La IA multiplica capacidades. Si quien tiene recursos accede a ella, despega; si se la niega a los que menos tienen, el rezago será brutal. En América Latina creamos grandes brechas con el Internet porque los gobiernos se dedicaron más a regular y controlar que a expandir el conocimiento. No podemos repetir ese error. la brecha del Internet aún persiste debido a la falta de alfabetización digital y de conexión. Con la IA, es urgente que el Estado y la empresa privada trabajen juntos para cerrar esa grieta antes de que sea insalvable.

Otro problema estructural es el punto ciego de los datos. Por ejemplo, si entrenamos una IA médica solo con expedientes de hospitales en Boston o Londres, el sistema será excelente diagnosticando a hombres blancos occidentales, pero fallará con una mujer indígena en nuestros países

Y el costo de la IA es otra barrera. Las mejores IAs hoy son de pago. Si la educación de calidad y las herramientas más potentes se vuelven un lujo privado, crearemos castas cognitivas, lo que sería devastador.

¿Qué responsabilidades tienen las grandes empresas tecnológicas en el desarrollo ético de la IA y qué papel deben jugar los Estados para regularla sin frenar la innovación? ¿Es necesario legislar su uso?: Defiendo la idea de que la ética es un acelerador, no un freno. Las empresas deben incorporar principios éticos desde el diseño porque no es aceptable lanzar productos peligrosos y esperar que la sociedad los corrija. También deben democratizar el acceso, colaborar en la infraestructura donde el Estado no llega y mitigar el impacto ambiental de sus centros de datos.

Los gobiernos no deben regular la tecnología misma, porque cambia demasiado rápido, sino sus efectos. Deben prohibir discriminación algorítmica, perseguir deepfakes dañinos y garantizar responsabilidad humana y nunca bloquear el desarrollo técnico.

Se debe incentivar la innovación local y a los emprendedores locales.

En su libro de ficción “Robots con Alma: atrapados entre la verdad y la libertad”, menciona escenarios futuros con IA general o sistemas autónomos avanzados. ¿Qué tan cerca estamos de ver una inteligencia que iguale o supere al ser humano en la mayoría de las tareas?: En mi novela exploro ese horizonte, pero defiendo con firmeza que los valores humanos y filosóficos constituyen esa inteligencia tradicional insustituible que nos hace lo que somos. En la realidad actual se debe distinguir con claridad entre mímica y conciencia.

Quizás en la próxima década se pueda ver una Inteligencia Artificial General que pueda imitar el razonamiento humano en casi cualquier tarea intelectual. Sin embargo, hay una barrera filosófica infranqueable que abordo y es la intencionalidad. La IA puede escribir un poema, pero no siente la necesidad de hacerlo. No ama, no sufre, no teme morir. Sin biología ni mortalidad puede tener conocimiento, pero la conciencia y la sabiduría siguen siendo patrimonio humano.

Guatemala y otros países en desarrollo suelen adoptar estas tecnologías sin marco regulatorio sólido. ¿Cuáles deberían ser los primeros pasos para una política pública responsable en IA?: No debemos copiar leyes europeas o de otros países. Europa regula desde la abundancia; nosotros en Latinoamérica debemos regular para el desarrollo. El primer paso no es prohibir, es construir infraestructura. La conectividad no puede depender solo de empresas privadas locales o extranjeras; el Estado no puede delegar toda la responsabilidad, sería renunciar a la soberanía.

También debemos asegurar la soberanía de datos. No podemos permitir que la información de los ciudadanos sea materia prima barata para otros. La piedra angular es la educación, desde la alfabetización digital, al pensamiento crítico, hasta la ética y la filosofía.

Muchos personas no entienden cómo funcionan estos modelos, pero los usan a diario. ¿Qué debería saber la gente —lo mínimo indispensable— para tomar decisiones informadas ante sistemas de IA?: La IA es una máquina de autocompletar muy sofisticada, no una enciclopedia infalible. Puede alucinar e inventar datos con absoluta convicción. Verificar siempre es obligatorio.

Segundo, la privacidad. Todo lo que se escribe en un chat gratuito puede ser usado para entrenar modelos futuros. Nunca hay que introducir datos sensibles como información financiera o íntima.

Tercero, entender el sesgo. La IA tiene la voz de quienes la entrenaron. Por eso, enseñar pensamiento crítico es más urgente hoy que enseñar herramientas específicas. La verdadera protección es formar ciudadanos que duden, comparen y cuestionen, que no acepten las respuestas como las únicas posibles.

¿Cómo impactará la IA en la educación? ¿Estamos preparando a los estudiantes para convivir con una tecnología que evoluciona más rápido que los planes de estudio?: El sistema educativo corre riesgo de quedarse obsoleto si sigue premiando la memorización. La IA ya ganó ese concurso. La alfabetización digital es hoy tan crucial como la alfabetización tradicional lo fue para nuestros bisabuelos. Quien no domine los nuevos códigos quedará excluido del diálogo social y económico.

La educación debe girar hacia un neohumanismo tecnológico, reforzar filosofía, ética, debate, negociación, pensamiento sistémico, todo lo que la máquina no puede replicar.

Se debe educar para que los jóvenes sepan abrazar y se adapten a un mundo cambiante. La escuela debe dejar de ser fábrica de respuestas y convertirse en taller de buenas preguntas.

¿Qué mensaje le daría a quienes sienten miedo ante la IA y la ven como una amenaza más que una herramienta y qué les diría a los que no miran los peligros que encierra?: A quienes sienten miedo les diría que el temor paraliza, y en este siglo quedarse quieto es retroceder. Lo esencial no es temerle, sino aprender a manejarla. La tecnología por sí sola no nos quitará el trabajo, sino que lo hará aquella persona que sepa utilizar mejor las nuevas herramientas.

Para cerrar… ¿Un comentario final?: Retomo el corazón de mi novela, donde los personajes se debaten entre la verdad y la libertad. No son solo recursos narrativos, son los pilares invisibles de toda democracia. En esta era de IA debemos elegir si los afirmamos con más fuerza o si permitimos que se desvanezcan entre la mentira y la manipulación.

La tecnología puede inclinar la balanza en cualquier dirección. Mal usada, puede convertirse en una maquinaria de desinformación que distorsione nuestra percepción de la realidad. Bien orientada, puede ser una aliada de la democracia, capaz de ampliar el acceso al conocimiento, transparentar decisiones públicas y potenciar nuestra creatividad.

Al final, el rumbo no lo marca la tecnología sino nuestras decisiones.